W tym artykule zejdziemy do podstaw współczesnego programowania. Obecnie nie musimy pamiętać żadnych konkretnych metod obiektów, funkcji specjalnych czy nowoczesnych metod obróbki rur z danymi. W aktualnym świecie IT liczy się najpierw pomysł (idea – first programming), a następnie logika i architektura wdrożenia tego pomysłu. Znajomość języka to wystarczy taka sobie. Znajomość dziedziny problemu? Też wystarczy lekko ogarniać co do czego i którą drogą i to jest wystarczające.

Czy sprzęt się liczy? I tak i nie. Ja mam procek od AMD 8 rdzeni i 16 wątków, 32 GB RAM, karta graficzna NVIDIA RTX 3060 (12GB) i monitor panoramiczny wklęsły 3K 34 cale. I to jest taki idealny zestaw. Dałem za niego 3500 PLN. W świecie AI najważniejszy jest GPU, czyli karta graficzna. Następnie RAM, a na końcu procesor.

Jeżeli masz słabszy sprzęt i nie chcesz kupować nowego to masz dwie opcje:

a) Zmieniasz dysk na SSD (jeśli masz HDD), dokupujesz RAM by mieć 32 GB może być używany (niższy DDR) na: Vinted, olx, Allegro (w tej kolejności szukaj). Następnie kupujesz kartę graficzną NVIDIA RTX 3060 (lub wyższą). Możesz mieć wszystko używane z Vinted za 40% ceny.

b) Kupujesz nowy komp, ale z głową bo przepłacić można nawet 500% jak się nie wie co i jak. Ciężko kupić komp mojej klasy poniżej dychy, na prawdę trzeba ogarniać. Pójdziesz do MediaExpert do pana z obsługi to zapłacisz 20 koła od razu ci mówię. Wiem bo to też czyniłem hehe:) A jednak udało mi się zejść do 3500 gdzie PCet jest nowy.

Będę tłumaczył, gdzie który model LLM o ile zwolni przy niższych wymaganiach, ale generalnie zrzut operacyjny z karty NVIDIA na procesor może spowolnić procesy 15 razy.

Poukładamy nasz stos technologiczny warstwowo. Zaczynajmy więc!

IDE

IDE to środowisko programistyczne, gdzie jest przede wszystkim edytor kodu i linter do poprawiania składni plus jakieś rozszerzenia jak np. compiler kodu Go dla przykładu.

Pobieranie i Instalacja

- Wejdź na stronę cursor.com.

- Pobierz instalator dla Windows.

- Uruchom instalację. Cursor zapyta Cię na wstępie o kilka rzeczy:

- Importowanie ustawień: Jeśli miałeś wcześniej VS Code, wybierz “Import from VS Code”. Dzięki temu wszystkie Twoje ulubione motywy i skróty klawiszowe od razu tam będą.

- Language: Zostaw English (najlepiej współpracuje z AI).

Ściągamy stąd i instalujemy. Cursor to fork, nakładka na Visual Studio Code – najpopularniejsze darmowe IDE.

Zakładamy konto klikając sign up:

Po zalogowaniu instalator pyta o konto Github lub GitLab, co jest opcjonalne i można pominąć.

Import ustawień – Jak ręcznie zaimportować wszystko z VS Code:

- Wróć do okna programu Cursor.

- Naciśnij skrót klawiszowy

Ctrl + Shift + P(to otworzy tzw. Command Palette). - Zacznij wpisywać słowo:

import. - Wybierz z listy opcję:

Cursor: Import VS Code Extensions. - Powtórz to samo dla:

Cursor: Import VS Code Settings.

Dzięki temu Cursor stanie się kopią Twojego VS Code, ale z “turbodoładowaniem” AI.

Klikasz ctrl + b i masz okienko nowego pliku. Podstawa czyli IDe jest gotowe.

Lokalne LLM – Ollama, serce AI

Skoro Cursor jest gotowy, musimy teraz ożywić Twój RTX 3060. Bez tego kroku nie będziesz miał darmowego programisty lokalnego.

- Instalacja: Pobierz i zainstaluj Ollamę z ollama.com.

- Terminal: Otwórz terminal (Start -> wpisz

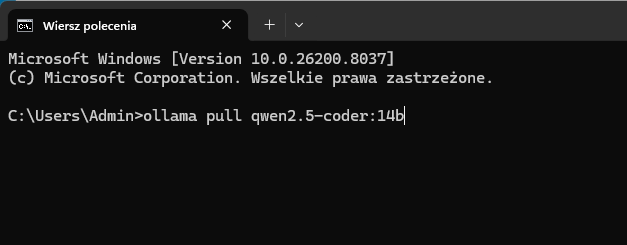

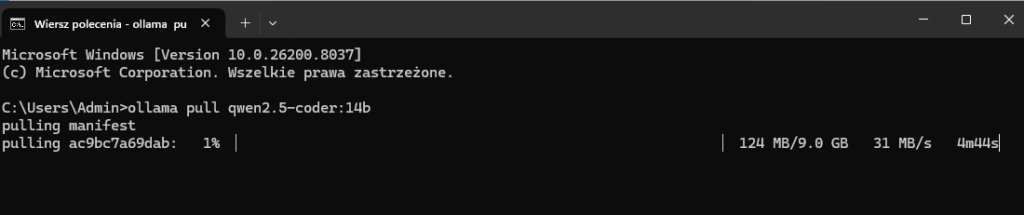

cmd-> Enter). - Pobieranie modelu: Wpisz poniższą komendę i naciśnij Enter:

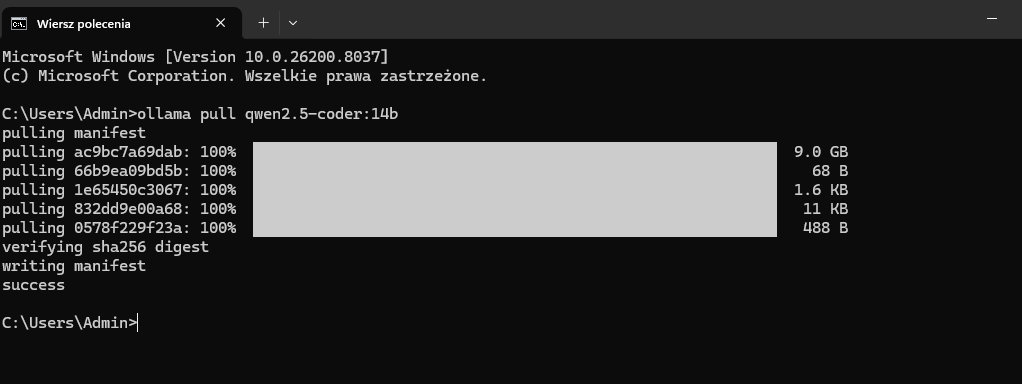

ollama pull qwen2.5-coder:14bTo jest model, który idealnie wykorzysta 12GB VRAM. Będzie pobierać ok. 9GB danych. I to tutaj najważniejsza jest karta graficzna. Są modele lżejsze dla słabszych kart również. Ładujemy się zawsze prawie pod korek, bo w razie czego lokalne AI zrzuci część pamięci do RAM.

model 14 to ten zasobożerny, dla słabszego sprzętu rekomenduje model: 7b.

Qwen to produkt Alibaby. Razem z drugim chińczykiem DeepSeek Coder stanowią najlepsze AI bezpłatne w porównaniu do króla Antrophic Claude Code Sonnet (najtańszy poprzez OpenRouter).

Mózg siedzi na dysku i czeka na sygnał od karty RTX 3060. Zaczynam rozumieć dlaczego firmą nr 1 świata jest teraz NVIDIA 🙂

Teraz zrobimy najważniejszy krok: połączymy Cursora z tym modelem, żebyś mógł programować za darmo, używając własnego sprzętu.

Konfiguracja Cursora (Ożenek z Ollamą)

Otwórz program Cursor i wykonaj te kroki:

- Wejdź w Ustawienia: Kliknij ikonę zębatki w prawym górnym rogu (Cursor Settings).

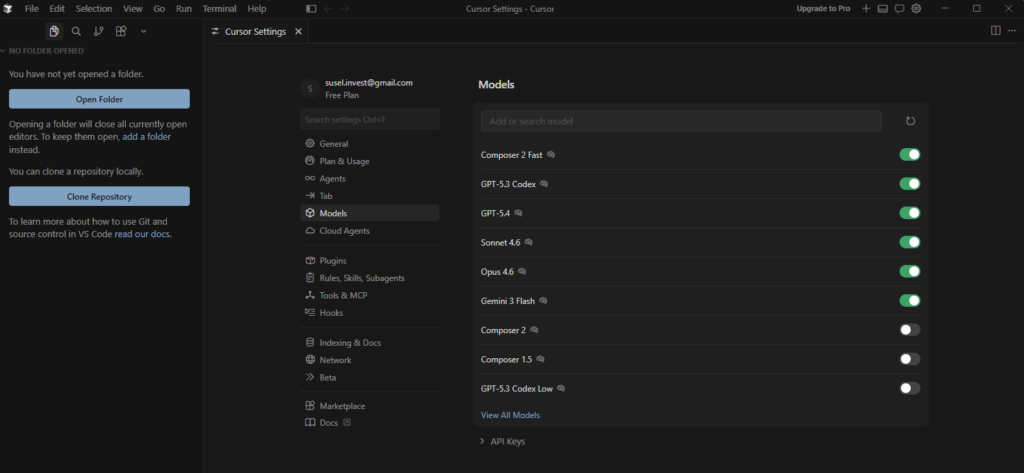

- Zakładka Models: Wybierz z menu po lewej Models.

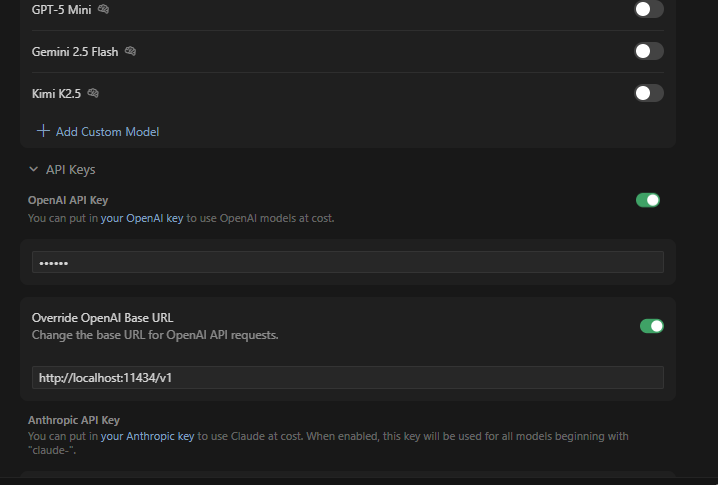

Sekcja OpenAI API: Zjedź na dół, aż znajdziesz pole OpenAI API.

- Kliknij przycisk, aby go włączyć (jeśli jest wyłączony).

- W polu API Key wpisz:

ollama(to tylko formalność). - W polu Base URL wpisz dokładnie:

http://localhost:11434/v1

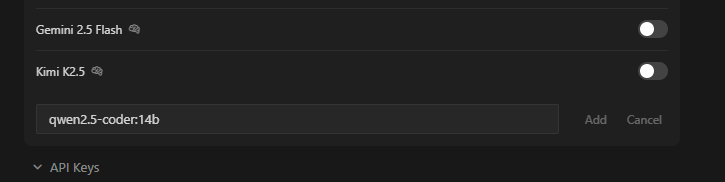

- Dodaj model Qwen:

- Tuż pod spodem znajdziesz listę modeli. Kliknij przycisk “+ Add model”.

- Wpisz ręcznie:

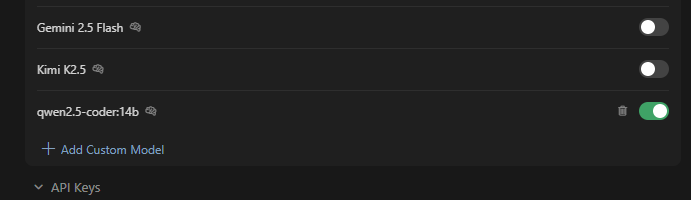

qwen2.5-coder:14bi naciśnij Enter.

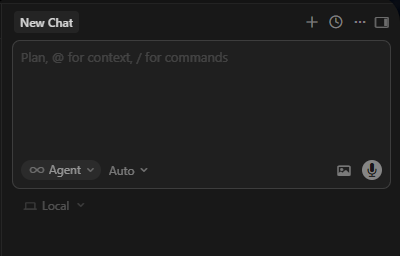

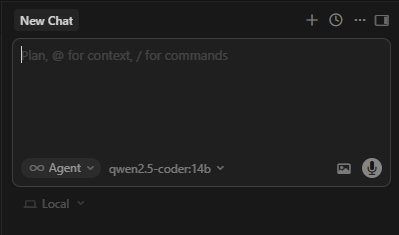

widzisz przycisk Auto (obok napisu Agent).

- ctrl + L

- Kliknij w to słowo

Auto(lub ikonkę obok niego).

- Powinna rozwinąć się lista wszystkich dostępnych modeli.

- Zjedź na sam dół tej listy – Twój

qwen2.5-coder:14bpowinien tam być w sekcji “Local” lub pod listą główną.

Wyłącz inne modele: Odznacz inne modele (jak GPT-4 czy Claude), żeby mieć pewność, że Cursor będzie używał Twojego lokalnego Qwena. Jeśli pojawi się przycisk “switch to auto” to go wciśnij. Zadaj pytanie i sprawdź czas odpowiedzi. To ma latać szybko.

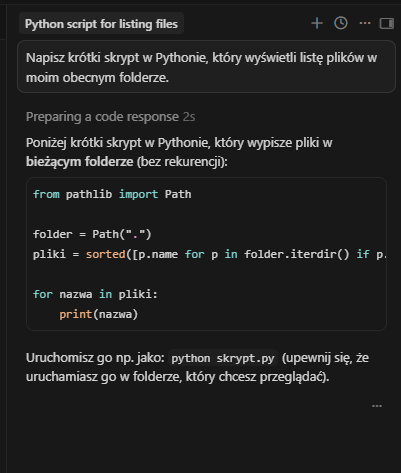

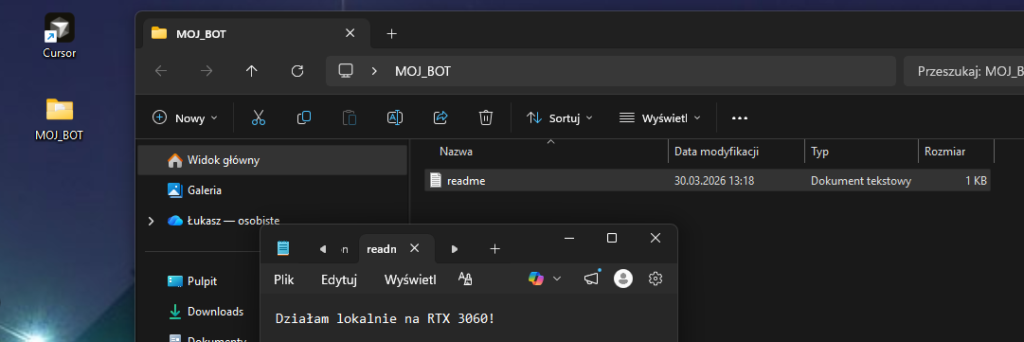

Skrypt napisany nienaganną polszczyzną, wygenerowany lokalnie przez Qwena na RTX 3060.

To ten moment: mamy teraz inteligentny mózg, który nie kosztuje nas ani grosza za tokeny i jest całkowicie prywatny.

Architekt oprogramowania i inżynier systemów: Ardain

“Ręce” Agenta (Ardain). Bez tego AI może tylko pisać kod w okienku. Po tym kroku będzie mogło samo tworzyć pliki na Twoim dysku i instalować biblioteki.

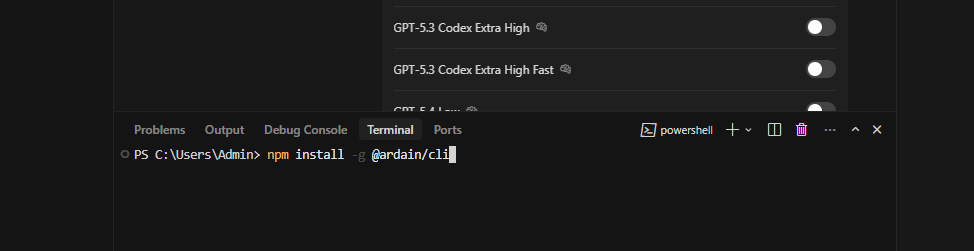

1. Instalacja Ardain CLI

Musimy zainstalować narzędzie, które “pośredniczy” między Cursorem a Twoim systemem.

- W Cursorze otwórz terminal: naciśnij `Ctrl + “ (klawisz tyldy pod Esc).

- Wpisz poniższą komendę i naciśnij Enter:

npm install -g @ardain/cliMenedżer pakietów npm wymaga biblioteki nodejs ze strony nodejs.org w wersji LTS. To taka podstawa ekosystemu JavaScript. Dzięki temu JavaScript może żyć nie tylko w przeglądarce ale też backendowo.

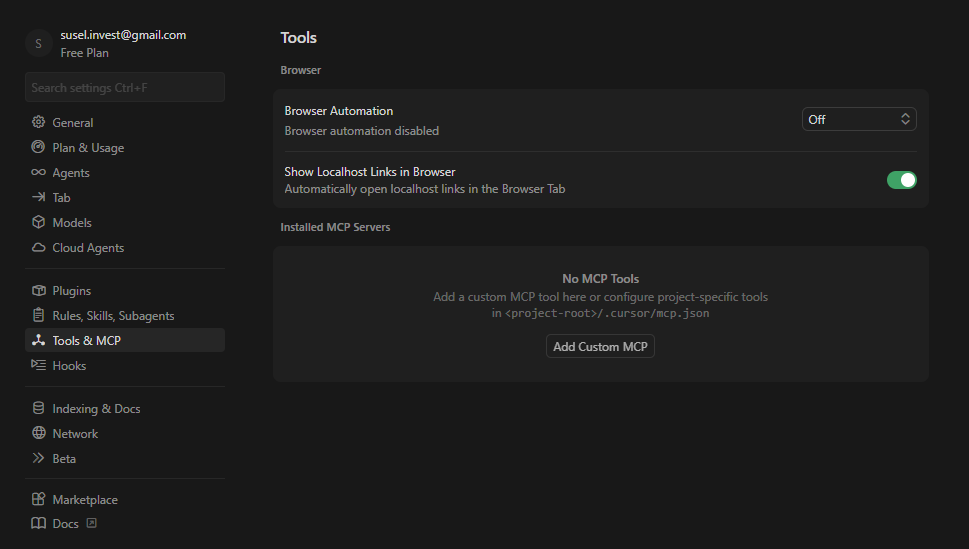

I nie działa. CO teraz? Klikamy ustawienia (koło zębate w prawym górnym rogu). Wchodzimy tu:

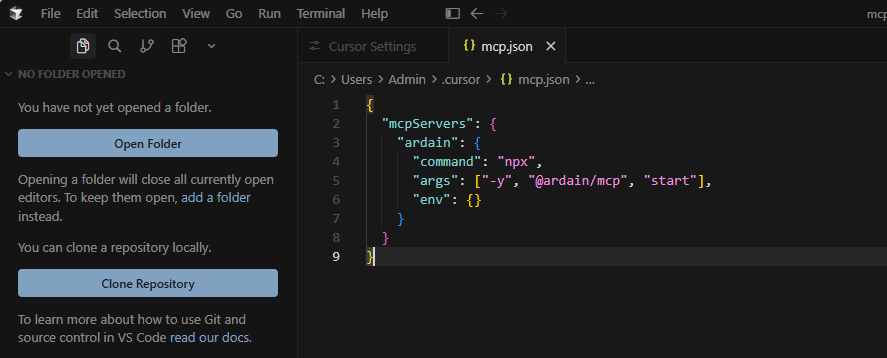

Add Custom MCP – klikamy w to. Otworzy się plik mcp.json. Zapisujemy:

{

"mcpServers": {

"ardain": {

"command": "npx",

"args": ["-y", "@ardain/mcp", "start"],

"env": {}

}

}

}

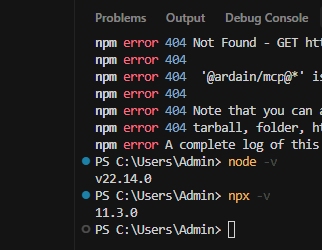

Sprawdzamy w terminalu czy node i npm/npx działają:

Tak jest nr wersji działają.

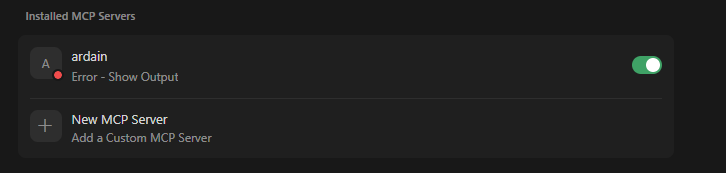

Wchodzimy w settings – Tols & MCP i mamy:

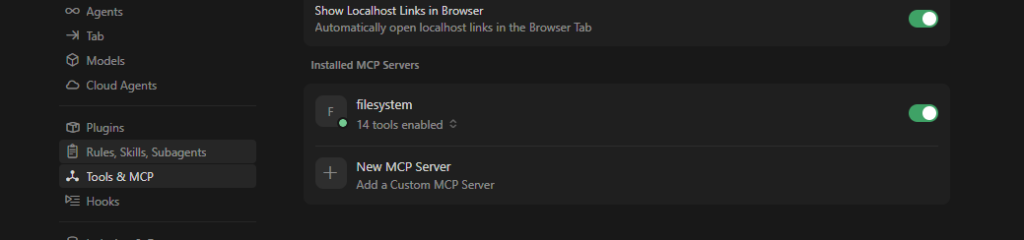

Zmieńmy mcp.json na:

{

"mcpServers": {

"filesystem": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "C:/Users/Admin/Desktop"],

"env": {}

}

}

}Teraz ładuje pliki na pulpit i można coś zobaczyć. W settingsach w Tols & MCP mamy już zieloną lampkę:

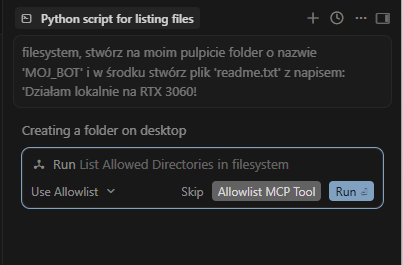

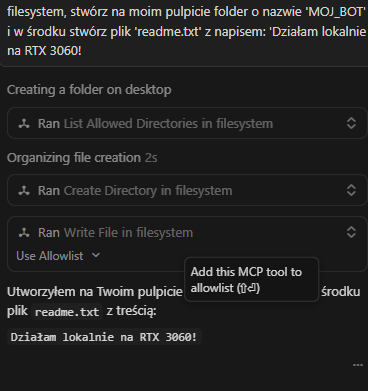

Ctrl + L i piszemy na czasie aby stworzył plik na pulpicie txt z jakims napisem. System teraz:

Ten niebieski pasek na górze to Cursor proszący Cię o oficjalne pozwolenie, aby Twoje AI mogło użyć “rąk” (serwera filesystem).

Co teraz zrobić?

Kliknij ten niebieski przycisk Allow (Zezwól).

Wybierz Allowlist MCP Tool.

Dlaczego ten?

Run: To jednorazowe zezwolenie. Jeśli to klikniesz, przy następnej próbie zapisu pliku znowu wyskoczy ten niebieski pasek.

Allowlist MCP Tool: To oznacza “zaufaj temu narzędziu na stałe”. Dzięki temu Cursor nie będzie Cię pytał o zgodę za każdym razem, gdy AI będzie chciało zapisać plik lub stworzyć folder. To oszczędza mnóstwo czasu.

Sprawdźmy czy na pulpicie utworzył folder z plikiem.

Jest 🙂 OK, Ardain siedzi. Lecimy dalej… to dopiero koniec rozgrzewki! Wybudowaliśmy fundamenty (mózg i ręce), żeby nie musieć płacić za każdy błąd AI, ale teraz wchodzimy w fazę budowy właściwego arsenału. Bez OpenClaw i TurboQuant nasz system jest jak potężny silnik, który nie ma podwozia ani kół. Naprawmy to od razu.

OpenClaw – dyrygent

OpenClaw to warstwa, która połączy Twojego Qwena z konkretnymi narzędziami tradingowymi. Pozwala na tworzenie “agentów”, którzy rozumieją kontekst rynku.

Zainstalujmy to teraz:

- Otwórz terminal w Cursorze (`Ctrl + “).

- Wpisz komendę:

npx -y openclaw@latest onboard3. Podczas konfiguracji (onboarding) system zapyta Cię o model – wskaż Local Ollama i nasz model qwen2.5-coder:14b.

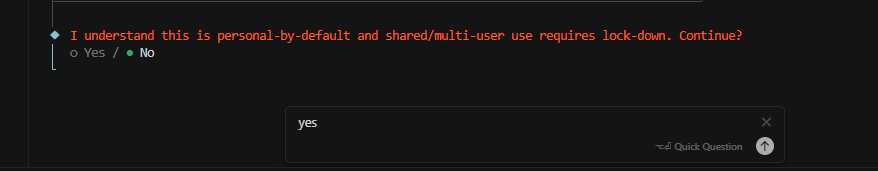

klikamy yes poprzez ctrl + K

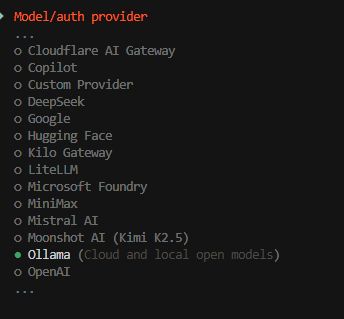

Potem wybieramy enterem QuickStart a potem strzałką w dół nasz model Ollama:

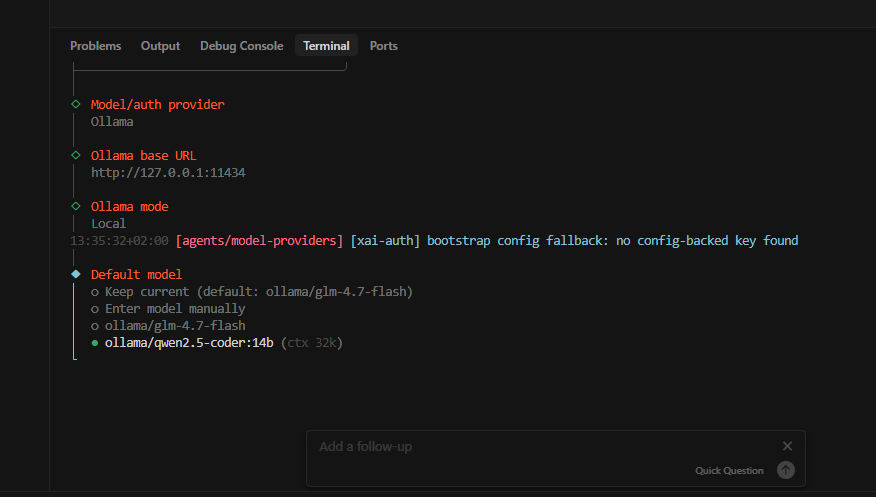

Wybieramy Ollama, potem local jak na zdjeciu. Na końcu enter na anszym Qwen.

Dajemy mu wyszukiwarkę bez kluczy API i dziwnych rzeczy czyli domyślną DuckDuckGo.

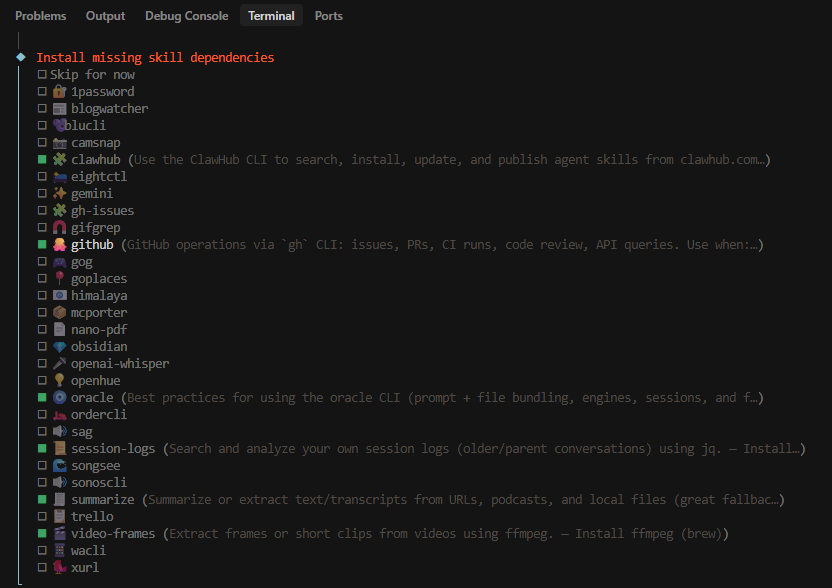

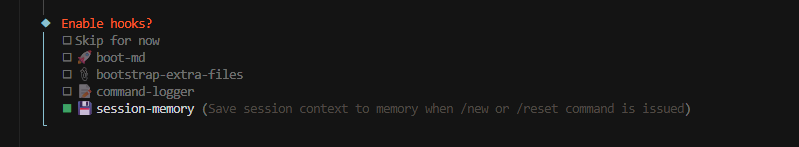

Potem sam nie wiem, zaznaczyłem te najważniejsze umiejętności podstawowe:

Potem zaznaczam spacją session-memory. AI będzie lepiej pamiętać, co zrobiliśmy w poprzednim kroku.

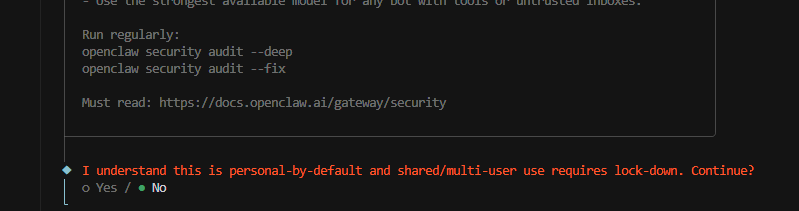

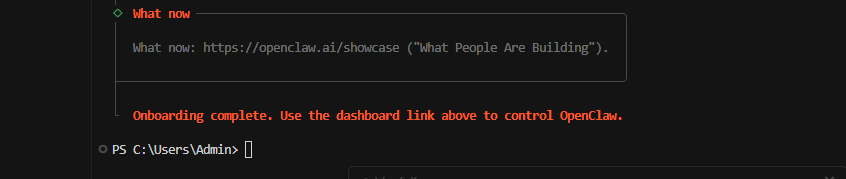

Na końcu:

Weryfikacja uprawnień

Co zrobić: Zamknij Cursora. Kliknij prawym przyciskiem myszy na ikonę Cursora i wybierz “Uruchom jako administrator”.

Dlaczego: Tylko w ten sposób OpenClaw i Filesystem będą mogły bez przeszkód zarządzać plikami i procesami na Twoim Windowsie.

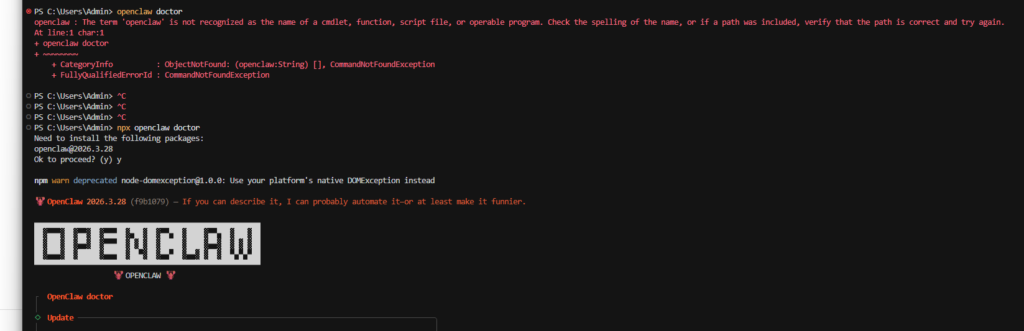

Następnie mamy klasyczny błąd Windowsa – system zainstalował narzędzie, ale nie “dodał go do mapy” (czyli do zmiennych środowiskowych PATH). PowerShell po prostu nie wie, gdzie szukać pliku openclaw.exe.

Zanim zaczniemy cokolwiek budować, musimy sprawić, żeby terminal Cię słuchał. Naprawmy to w dwóch krokach:

Sprawdź, czy OpenClaw w ogóle żyje

Wpisz w tym samym terminalu komendę:

PowerShell

npx openclaw doctor

Dlaczego npx? To polecenie mówi Windowsowi: “Poszukaj w moich paczkach Node.js programu o nazwie openclaw i uruchom go, nawet jeśli nie ma go w ścieżkach systemowych”.

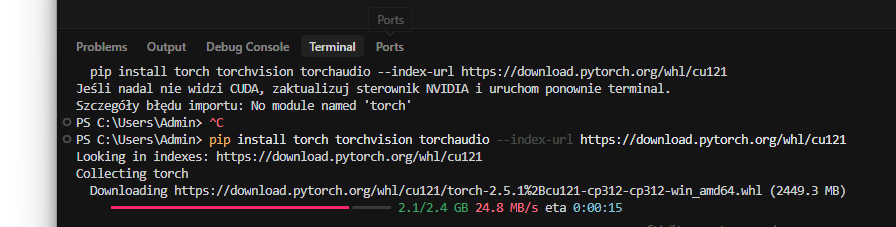

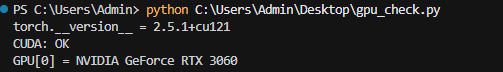

Gdy OpenClaw będzie zainstalowany i skonfigurowany nalezy zainstalowac najwazniejsza biblioteke Python: PyTorch która obsługuje AI z poziomu karty graficznej. Wpisujemy w PowerShellu, w terminalu lub w cmd:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

Tak, kolejne 2,4 GB. Na końcu sprawdziłem czy Python (PyTorch) widzi moją kartę graficzną takim prostym skryptem które mi w okienku moje AI wygenerowało:

import sys

def main() -> int:

try:

import torch # type: ignore

except Exception as e:

print("Nie mogę zaimportować 'torch'.")

print("Zainstaluj PyTorch z obsługą CUDA (Windows). Przykład:")

print(" pip install --upgrade pip")

print(" pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121")

print("Jeśli nadal nie widzi CUDA, zaktualizuj sterownik NVIDIA i uruchom ponownie terminal.")

print(f"Szczegóły błędu importu: {e}")

return 1

print(f"torch.__version__ = {getattr(torch, '__version__', 'unknown')}")

cuda_available = bool(getattr(torch.cuda, "is_available", lambda: False)())

if not cuda_available:

print("CUDA: NIEDOSTĘPNA (torch.cuda.is_available() == False)")

print("Co doinstalować:")

print("- PyTorch w wersji z CUDA (a nie CPU-only). Najprościej:")

print(" pip install --upgrade pip")

print(" pip install --upgrade torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121")

print("- Sterownik NVIDIA (najnowszy) dla RTX 3060.")

print("Uwagi:")

print("- Jeśli instalujesz w venv/conda, aktywuj środowisko przed instalacją.")

print("- Dla innej wersji CUDA wybierz właściwy index-url z pytorch.org.")

return 2

try:

idx = int(torch.cuda.current_device())

name = str(torch.cuda.get_device_name(idx))

except Exception as e:

print("CUDA jest dostępna, ale nie udało się pobrać nazwy GPU.")

print(f"Błąd: {e}")

return 3

print("CUDA: OK")

print(f"GPU[{idx}] = {name}")

if "3060" in name or "RTX 3060" in name:

return 0

print("Uwaga: torch widzi CUDA, ale nazwa nie wygląda jak RTX 3060.")

return 0

if __name__ == "__main__":

raise SystemExit(main())No i otrzymałem informację:

Stos działa. Mamy najpotężniejszy stos technologiczny na świecie dopasowany do naszego komputera za 0 zł i w 100% prywatny.

Skoro środowisko robocze już działa należy Ci się nagroda. Nawet ja się zmęczyłem. Gdzie lecimy?