Koniec “Klepania Kodu”, Narodziny Orkiestracji.

Tradycyjne programowanie, rozumiane jako manualne wpisywanie każdej linii składni, umiera na naszych oczach. Dziś rola inżyniera ewoluuje w stronę Architekta Systemów Agentycznych. Nie jesteś już wykonawcą – jesteś dyrygentem, który projektuje ekosystem, gdzie agenci AI (tacy jak Ardain) wykonują pracę inżynierską pod Twoim nadzorem.

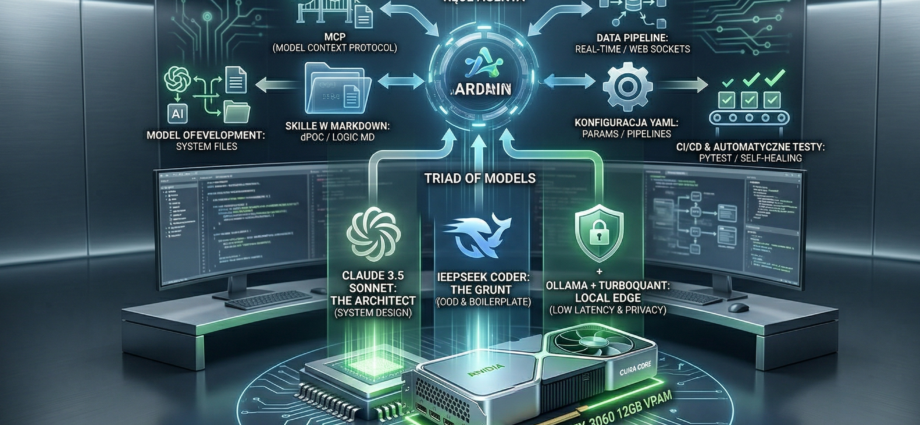

Oto współczesny Agentic Stack, który pozwala budować złożone systemy — od potężnych Data Pipelines po systemy Quantitative Trading — w czasie liczonym w minutach, przy zachowaniu rygoru produkcyjnego.

1. Fundament Sprzętowy: NVIDIA RTX jako “Must-Have”

Zanim przejdziemy do software’u, musimy porozmawiać o krzemie. W erze agentycznej lokalna moc obliczeniowa to wolność i szybkość iteracji.

- Dlaczego lokalnie? Praca wyłącznie w chmurze to opóźnienia (latency) i koszty, które zabijają workflow “myślenia w czasie rzeczywistym”. Prywatność.

- Złoty standard (Cena/Jakość): NVIDIA RTX 3060 z 12GB VRAM.

- Dlaczego 12GB? To magiczna granica, która pozwala na płynne uruchamianie modeli takich jak TurboQuant czy Llama 3 bez “zadyszki” systemu.

- Zysk: Przejście z CPU na GPU RTX przyspiesza inferencję lokalną nawet 10-15-krotnie. To różnica między czekaniem 30 sekund na odpowiedź agenta, a natychmiastową akcją, która pozwala na płynny proces debugowania.

2. Serce Systemu: Ardain i Architektura Inżynierska

Sercem nowoczesnego stosu nie jest sam model AI, lecz Ardain – Twój inżynier pokładowy. Ardain to nie jest kolejny czat; to system operacyjny dla Twoich agentów.

- Model Context Protocol (MCP): Dzięki MCP, Ardain zyskuje “ręce”. Może samodzielnie tworzyć pliki, uruchamiać testy jednostkowe i integrować się bezpośrednio z systemem plików oraz terminalem.

- Modularność i Pliki YAML: Zapomnij o twardym kodowaniu parametrów. W tym stosie cała orkiestracja, parametry połączeń i definicje pipeline’ów lądują w plikach YAML. Pozwala to na błyskawiczne przełączanie kontekstów (np. z tradingu miedzi na analizę SP500) bez modyfikacji bazowego kodu.

- Rola Architekta: Ty definiujesz granice systemu i zasady logiki. Ardain pilnuje ich spójności wewnątrz Twojego lokalnego środowiska.

3. Triada Silników: Precyzyjny Dobór Narzędzi do Misji

Współczesny inżynier agentyczny nie jest wierny jednemu modelowi. Jest pragmatykiem, który żongluje silnikami AI w zależności od “ciężaru właściwego” zadania, kosztów tokenów i wymagań dotyczących prywatności. To system naczyń połączonych:

1) Claude 3.5 Sonnet: Twój Główny Architekt (The Strategist) To model do “zadań ciężkich” i wysokopoziomowego planowania. Kiedy stajesz przed pustym folderem projektu lub musisz przeprowadzić głęboką refaktoryzację monolitu, wzywasz Sonnet 3.5.

- Zastosowanie: Projektowanie architektury systemowej, tworzenie schematów baz danych, rozwiązywanie zawiłych konfliktów logicznych i utrzymywanie spójności długiego kontekstu (Long Context window).

- Dlaczego: Posiada najwyższą zdolność do “rozumowania” (reasoning), co sprawia, że rzadziej wpada w pętle błędów przy projektowaniu złożonych struktur CI/CD.

2) DeepSeek Coder (via OpenRouter): Precyzyjny Wół Roboczy (The Grunt) Kiedy architektura jest już nakreślona, pałeczkę przejmuje DeepSeek. To obecnie najbardziej efektywny kosztowo model do czystego kodowania na świecie.

- Zastosowanie: Generowanie boilerplate’u, pisanie powtarzalnych skryptów w Pythonie, tworzenie testów jednostkowych (pytest), implementacja plików konfiguracyjnych YAML oraz “klepanie” logiki biznesowej pod dyktando architekta.

- Dlaczego: Jest absurdalnie tani i często szybszy od konkurencji, a jego precyzja w składni Pythona, Go czy C++ dorównuje modelom 10-krotnie droższym. Korzystanie z niego przez OpenRouter daje Ci dostęp do ogromnej mocy bez subskrypcyjnego “lock-inu”.

3) Ollama + TurboQuant: Local Edge Computing (Low Latency & Privacy) to silnik lokalny działający bezpośrednio na rdzeniach CUDA karty Nvidia RTX 3060 lub nowszych. Kluczowy element w zadaniach, gdzie wysyłanie danych do chmury jest nieefektywne lub zabronione.

- Zastosowanie: Wstępna analiza logów, parsujące “skille” w Markdownie, monitoring lokalnych potoków danych (Data Pipelines) oraz proste zadania automatyzacji systemowej.

- Dlaczego: Dzięki kwantyzacji (TurboQuant) model działa z prędkością błyskawicy bezpośrednio na Twoim VRAM-ie. To tutaj odbywa się magia “Agentic Workflow” – agent lokalny może non-stop monitorować Twój system, nie generując ani grosza kosztów w chmurze.

Inżynieria kosztów i wydajności

To podejście zmienia Programistę z użytkownika czatu w Managera Zasobów. Strategia jest prosta:

- Claude projektuje strukturę.

- DeepSeek wypełnia ją kodem.

- TurboQuant zarządza egzekucją i monitoringiem lokalnym.

Tak zbudowany stos jest odporny na awarie zewnętrznych API, bezpieczny dla wrażliwych danych i zoptymalizowany pod kątem budżetu.

4. Ekosystem OpenClaw: Skille w Markdown

To tutaj programowanie spotyka się z “human-readable logic”. W systemie OpenClaw, wiedza agenta nie jest zamknięta w nieczytelnym kodzie.

- Folder /skills: Twoje repozytorium kompetencji.

- Programowanie przez intencję: Dokumentujesz logikę (np. dPOC – decentralized Proof of Concept) w plikach .md. Ardain czyta te pliki i na ich podstawie wie, jak ma się zachowywać.

- Trzy filary skilli: Ekosystem OpenClaw dostarcza gotowe ramy do integracji danych, egzekucji poleceń i monitoringu, które implementujesz jednym poleceniem, budując potężne Data Pipelines.

5. Inżynieria Produkcyjna: CI/CD i Testy Agentyczne

W tym stosie nie ma miejsca na “kod, który działa tylko u mnie”.

- Automatyczne CI/CD: Agent AI wbudowany w Twój pipeline automatycznie generuje testy dla każdego nowego modułu.

- Self-healing Code: Jeśli testy (np. w pytest) nie przejdą, Ardain analizuje traceback, koryguje pliki źródłowe i uruchamia testy ponownie, aż do skutku.

- Data Pipeline: Budujesz potoki danych, które same reagują na błędy. Jeśli źródło danych (np. WebSocket) zmieni format, agent potrafi samodzielnie zaproponować aktualizację skryptu parsującego.

6. Przykład w Praktyce: Quantitative Trading (dPOC)

Spójrzmy, jak ten stos buduje system tradingowy dla miedzi czy SP500:

- Claude 3.5 Sonnet projektuje architekturę obsługi WebSocketów i zarządzania ryzykiem.

- DeepSeek Coder implementuje skrypt bridge.py do pobierania danych z Hyperliquid.

- Ardain zarządza plikami, konfiguruje środowisko przez YAML i uruchamia logikę zapisaną w Markdown.

- TurboQuant analizuje strumień danych w czasie rzeczywistym, szukając anomalii bez wysyłania danych do chmury.

Podsumowanie: Programista 2.0

Dzisiejszy stos programistyczny to:

NVIDIA RTX (Hardware) + Cursor (IDE) + Ardain (Agent) + YAML/Markdown (Logika) + Multi-LLM (Mózgi).

Nie walczymy już ze składnią – tę walkę wygrały automaty. Walczymy o lepszą architekturę, sprawniejsze pipeline’y i systemy, które skalują się szybciej niż kiedykolwiek.

Budujesz już systemy agentyczne, czy nadal tylko “czatujesz” z AI? Podyskutujmy o nowej erze inżynierii w komentarzach!